- (Обновлено:

- 9 минут

- Решение проблемы

Не так страшен чёрт, как его малюют

– русская пословица

Иногда довольно сложно понять, что от тебя хотят поисковые системы, что именно они понимают под значением «страницы низкого качества»? Порой смотришь на страницу и откровенно не понимаешь, почему же её невзлюбил Яндекс или Google. В этой статье мы рассмотрим страницы, которые ПС удаляют из поиска, считая недостаточно качественными.

- Что такое «низкокачественные страницы»

- Как найти проблемные страницы на своём сайте

- Типы низкокачественных страниц

- Влияние страниц низкого качества на ранжирование всего сайта

- И, главное, что делать с такими страницами

Страницы низкого качества в понимании поисковых систем

В блоге Яндекса Елена Першина даёт следующее определение страницы низкого качества: «Под понятием некачественная страница мы понимаем страницы, вероятность показа которых в поиске практически нулевая. По понятным причинам мы не рассказываем способы определения таких страниц, но это чёткий сигнал, что если вы хотите видеть эту страницу в поиске, то со страницей нужно что-то делать».

Внесём немного корректив в слова представителя Яндекса: так как алгоритмы иногда дают сбой, причём в пользу сайтов, страница может занимать ТОП, а потом бесследно пропасть из выдачи.

То есть, страницы низкого качества – это документы, которые не имеют ценности, не несут новую и полезную информацию, не дают релевантный ответ на вопрос пользователя, с точки зрения поисковых систем.

Как обнаружить удалённые низкокачественные страницы

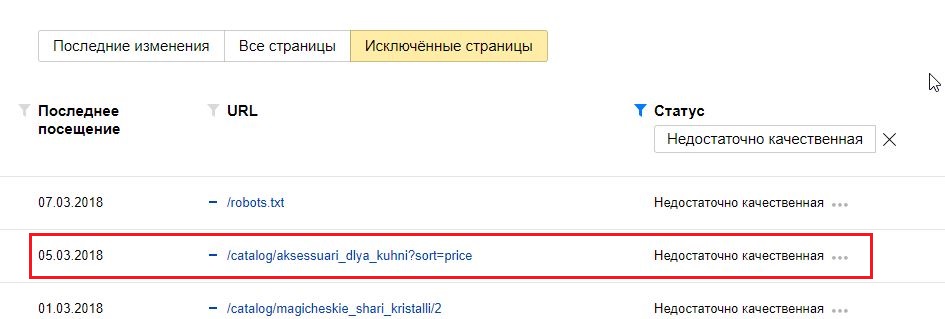

Яндекс.Вебмастер

Проще всего найти исключённые страницы, воспользовавшись инструментом Яндекс.Вебмастер.

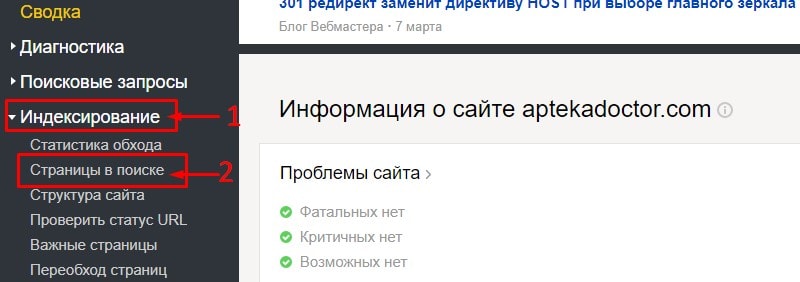

Переходим в раздел «Индексирование» – «Страницы в поиске».

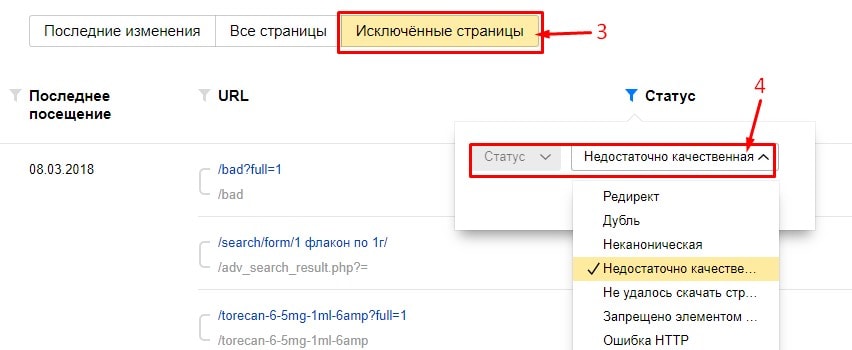

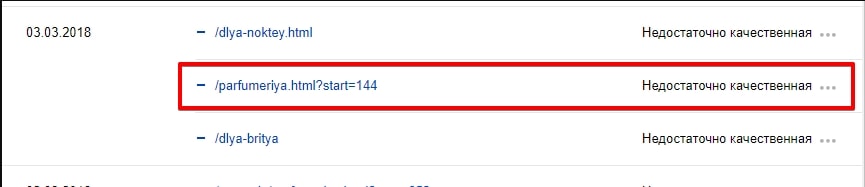

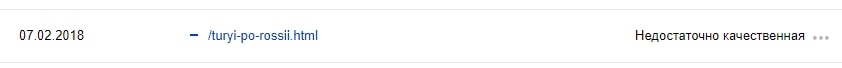

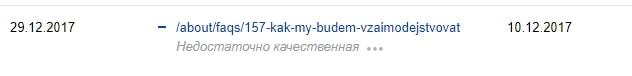

Переходим на вкладку «Исключённые страницы» – выбираем статус «Недостаточно качественная».

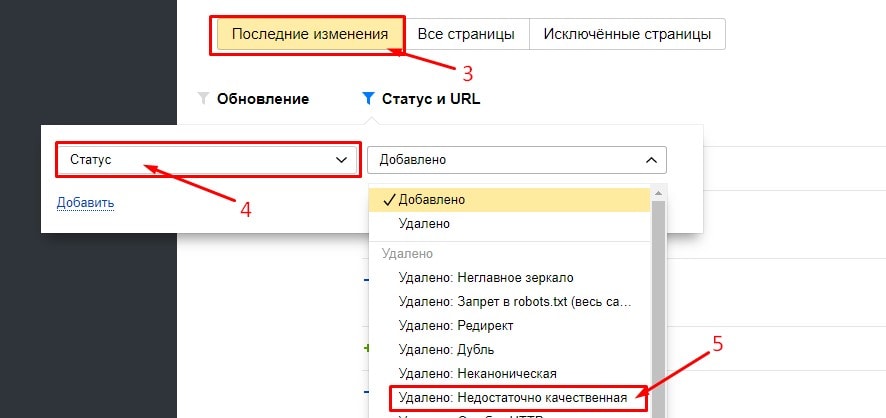

Можно, не переходя с «Последних изменений», выбрать статус «Удалено: Недостаточно качественная».

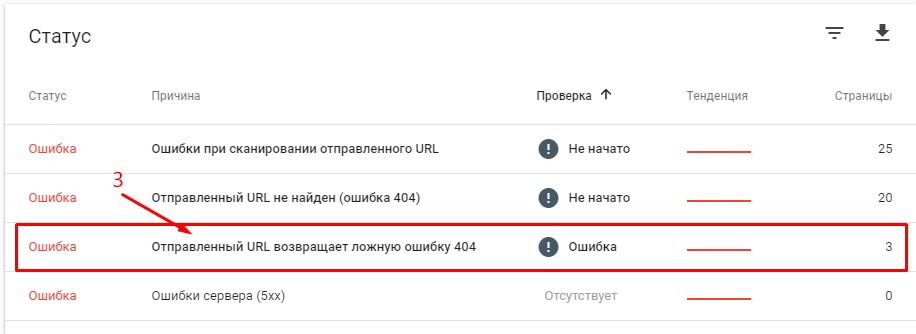

Google Search Console

В отличие от Яндекса, Google не предоставляет информацию о том, какие страницы были удалены из поиска из-за качества. Даже в новой бета-версии Google Search Console, к сожалению, эта функция отсутствует.

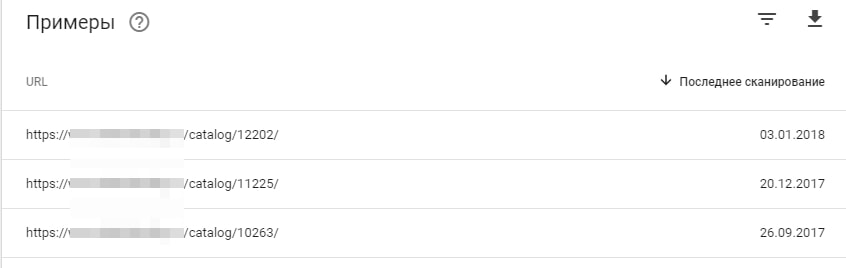

Единственным сигналом от Google сейчас можно считать «Отправленный URL возвращает ложную ошибку 404». В таких случаях нужно проанализировать страницы, убедиться, что они существуют, а не удалены (и просто ответ сервера некорректен). Подробнее о мягкой 404 можно прочесть в нашем блоге.

Итак:

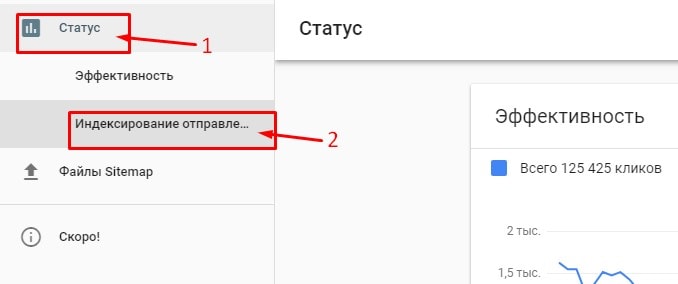

- Переходим в новую версию Google Search Console.

- В боковом меню находим «Статус» – «Индексирование отправленных URL».

- Выбираем строку «Отправленный URL возвращает ложную ошибку 404».

- Анализируем исключённые страницы.

Причины удаления страниц

Проанализировав большое количество различных сайтов и выявив закономерность у страниц, удалённых по причине низкого качества, мы пришли к следующим выводам:

1) Алгоритм Яндекса недоскональный: вместо того, чтобы отнести страницу в удалённые, например, по причине дублирования, он исключает её как низкокачественную.

2) Страницы низкого качества чаще встречаются на коммерческих сайтах – интернет-магазинах и агрегаторах, чем на информационных (за счёт автоматической генерации).

Типология удалённых страниц низкого качества

1. «Жертвы» некорректной работы алгоритма

К этой категории мы отнесём страницы, которые должны были быть удалены по другим причинам.

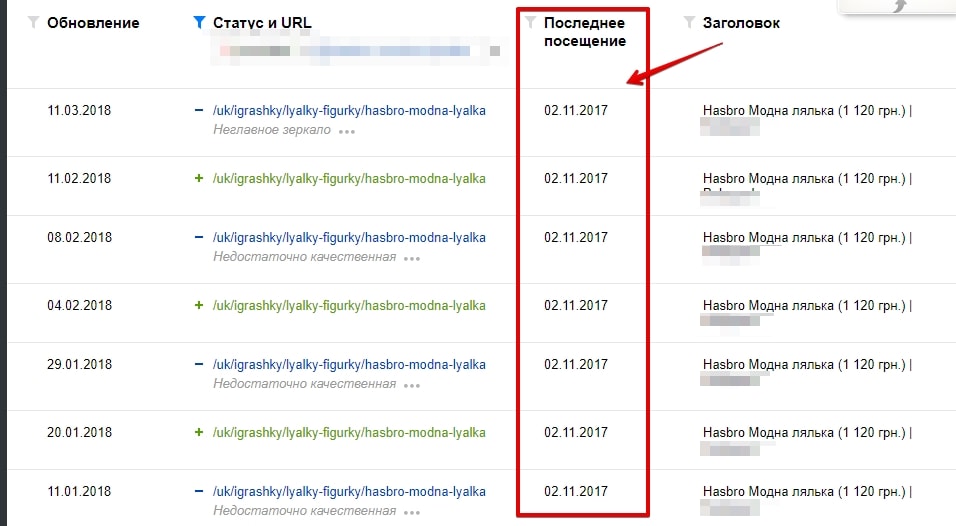

1.1. Дубли страниц

К страницам низкого качества довольно часто попадают дубликаты страниц.

Такие страницы довольно легко определить, если кроме URL ничего не уникализированно.

1.2. Страницы сортировки, пагинации и GET-параметры

Чаще Яндекс исключает такие страницы, как дубли, но, как показано на примере ниже, они могут быть удалены и по другой причине.

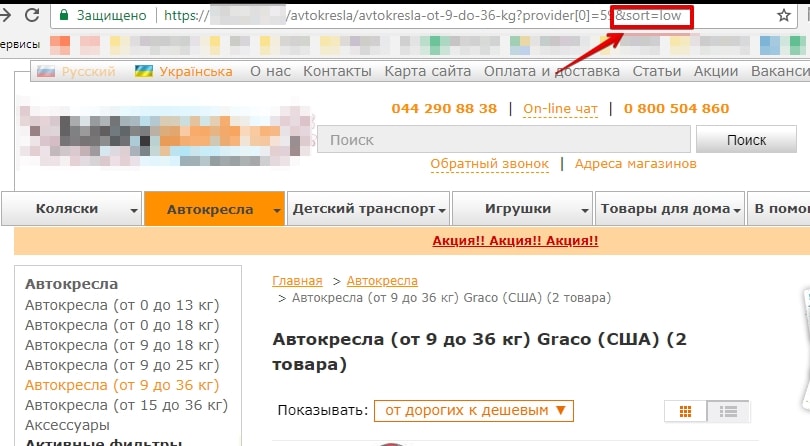

Страницы сортировки:

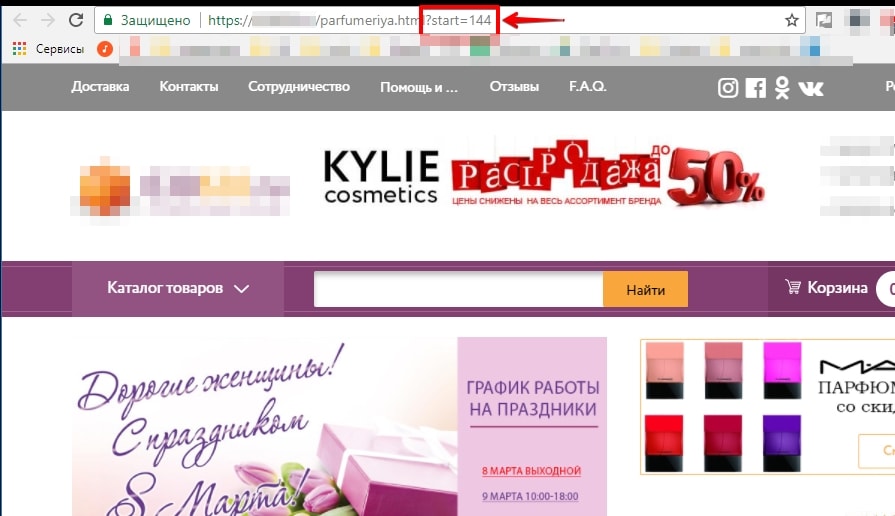

Страницы пагинации:

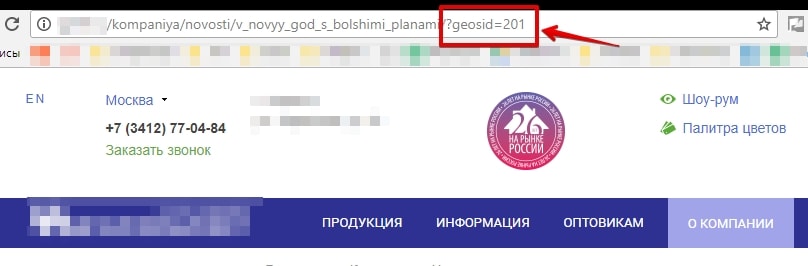

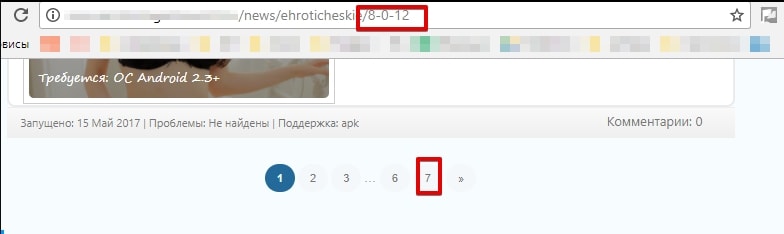

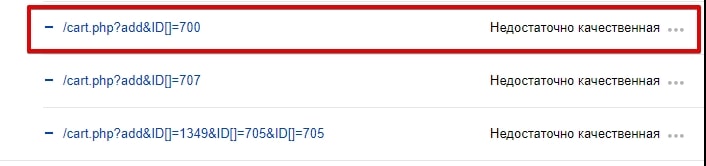

GET-параметры:

В этом примере GET-параметры определяют регион пользователя.

1.3. Неглавное зеркало

Сайт переехал на защищённый протокол. Долгое время робот Яндекса не знал, что делать со старой страницей на HTTP и, то удалял её как некачественную, то добавлял обратно в поиск. По итогу, спустя несколько месяцев, он удалил страницу как неглавное зеркало.

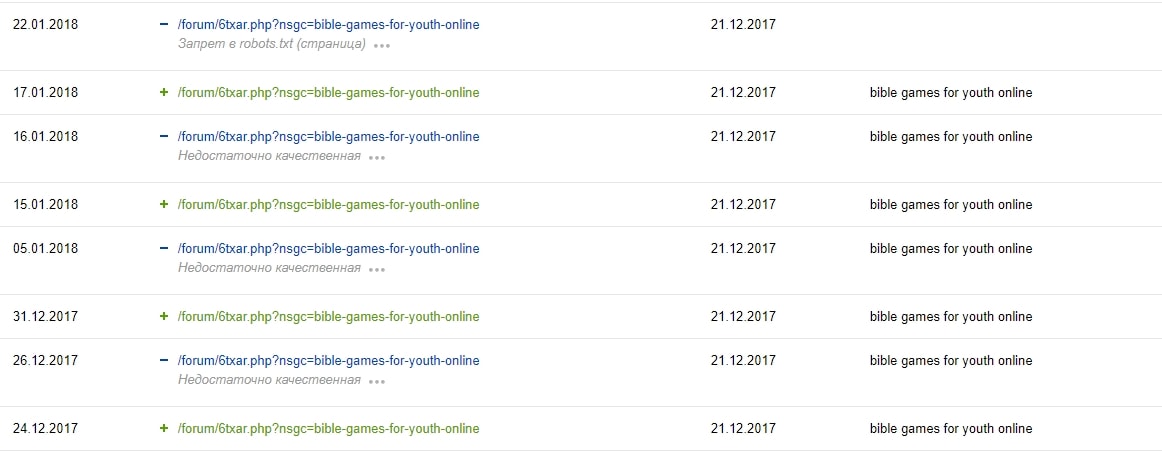

1.4. Страницы, закрытые в файле robots.txt

Директивы в файле robots.txt не являются прямыми указаниями для поисковых роботов, а служат больше рекомендациями. Исходя из практики, бот Яндекса больше придерживается установок, прописанных в файле, чем Google. Но не в этот раз. Как и в прошлом примере, «помучив» несколько раз страницу, он всё-таки «снизошёл» и удалил её из поиска как запрещённую в файле robots.txt.

2. Действительные недостаточно качественные страницы

В эту группу «я плох, бесполезен и никому не нужен» попадают страницы низкого качества, которые действительно являются таковыми.

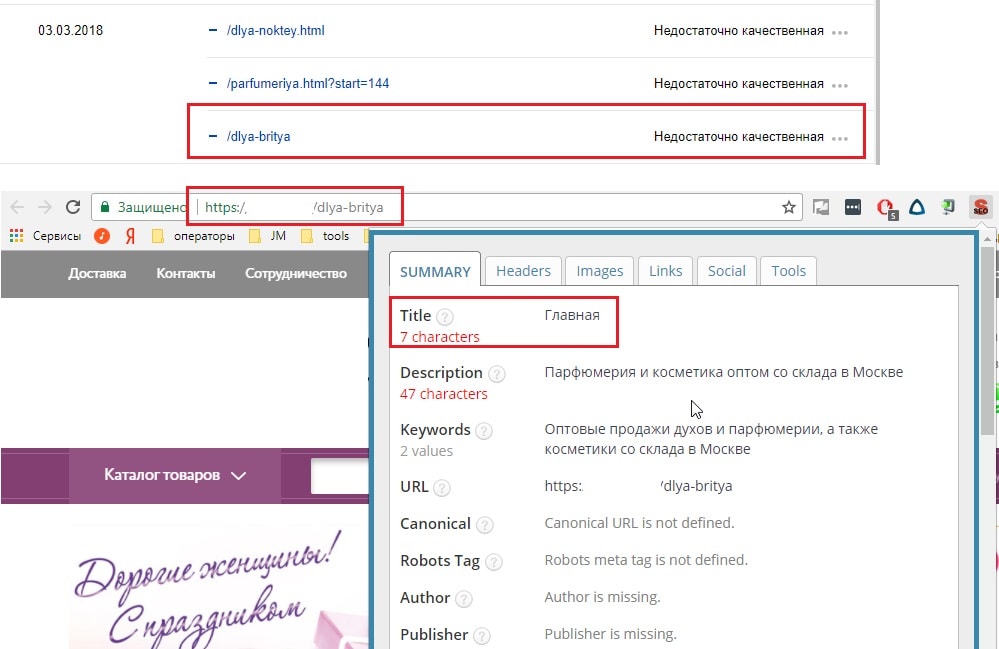

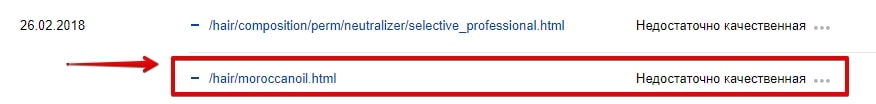

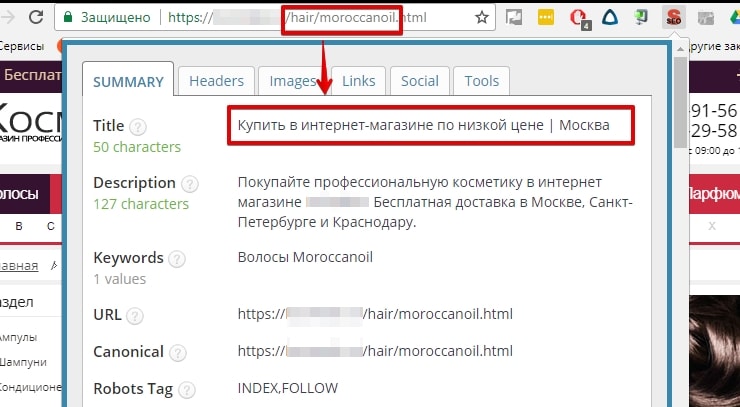

2.1. Шаблонная генерация страниц

Часто шаблонное заполнение и генерация страниц влечёт за собой ошибки внутренней оптимизации: неуникальные Title, отсутствует Description, с H1 что-то не так и т. д.

Тут важно сказать, что пользователь без проблем поймёт разницу в страницах и для него они могут быть даже полезными, но он о них не узнает, так как роботы стоят на страже порядка не допустят попадания данных страниц в поиск.

Увидев Title на странице, долго не пришлось гадать, что с ней не так.

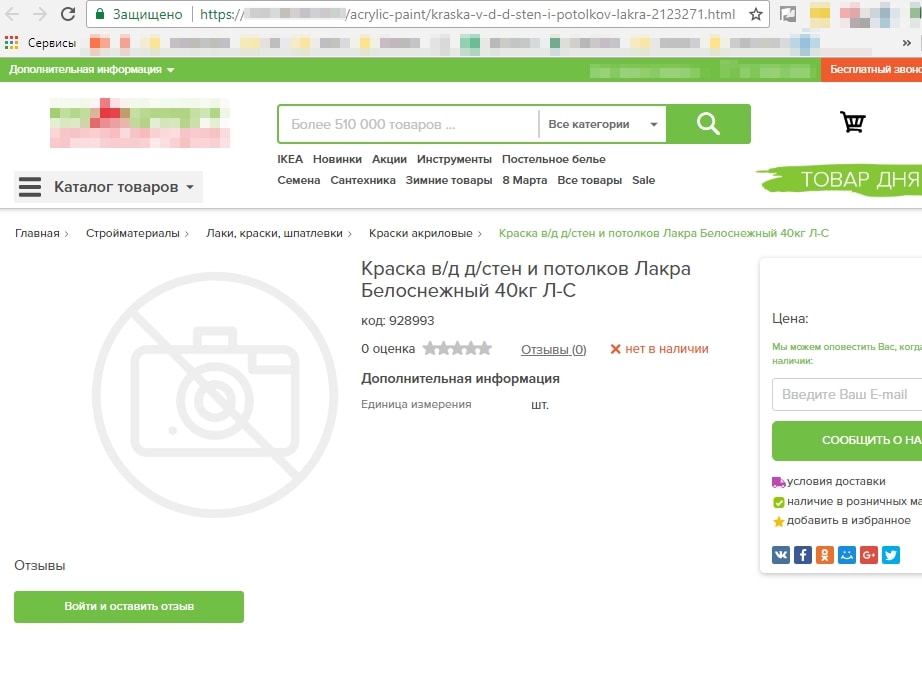

2.2. Плохое заполнение карточек товара

Создать карточку товара просто, а вот наполнить её качественным контентом, описанием товара, изображениями – не каждому под силу.

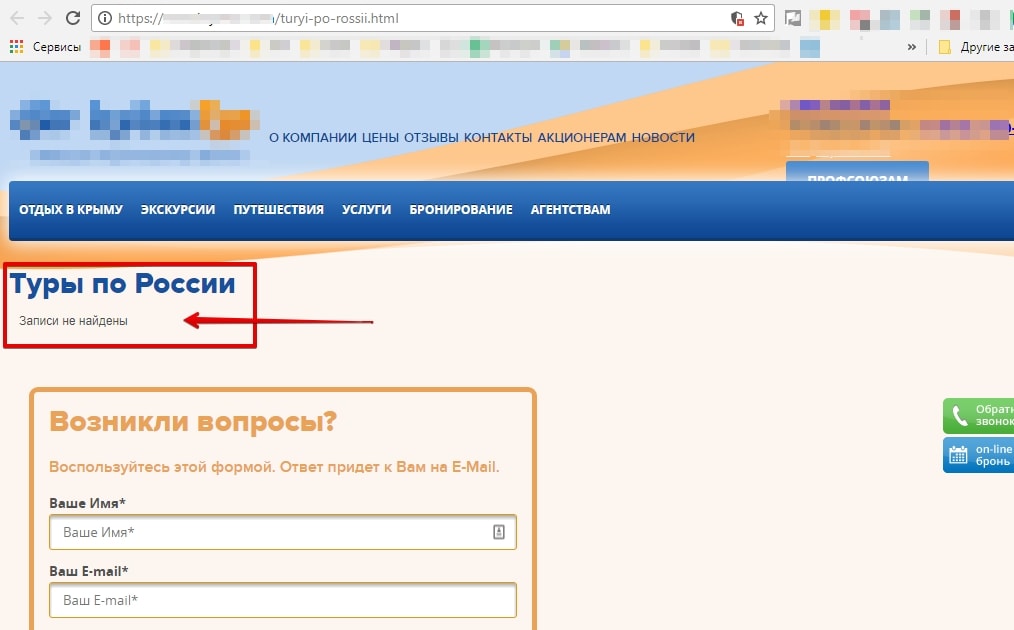

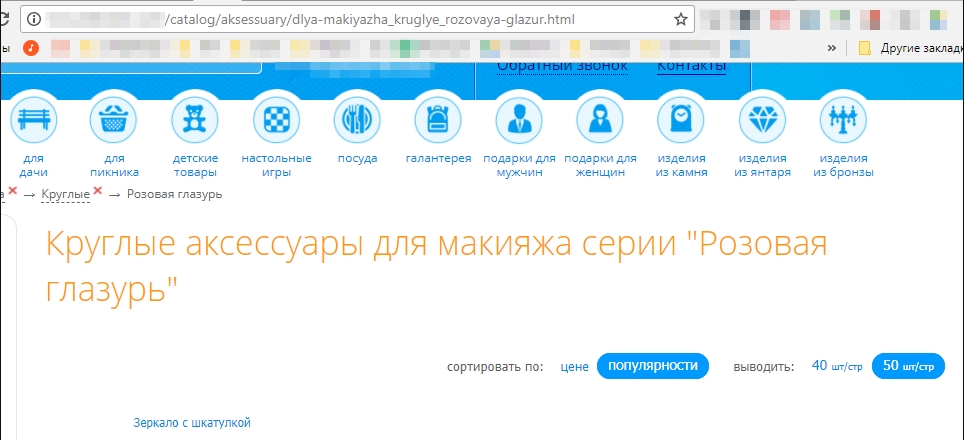

2.3. Листинг без листинга

Создавать страницы категорий/подкатегорий без товара – лишено смысла, так как:

- вряд ли такая страница попадёт в ТОП;

- вероятнее всего, показатель отказов на такой странице будет максимальный.

Об этом скажет и сам Яндекс, исключив страницу из поиска как недостаточно качественную.

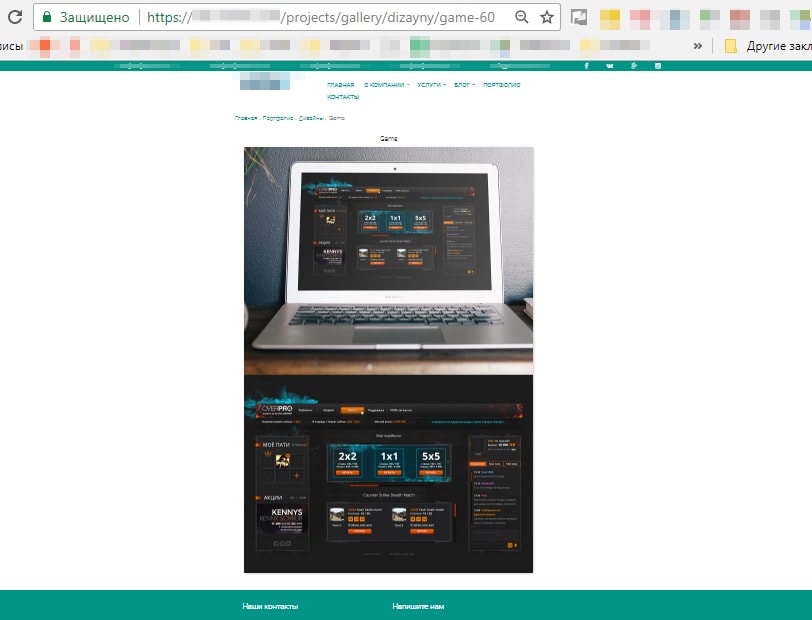

2.4. Страницы с малым количеством контента

Несмотря на слова поддержки Яндекса, что важно не количество контента, а качество, его отсутствие – не очень хорошая идея.

Например, на этой странице, кроме шаблонной части и двух изображений, ничего нет.

2.5. Страницы, не предназначенные для поиска

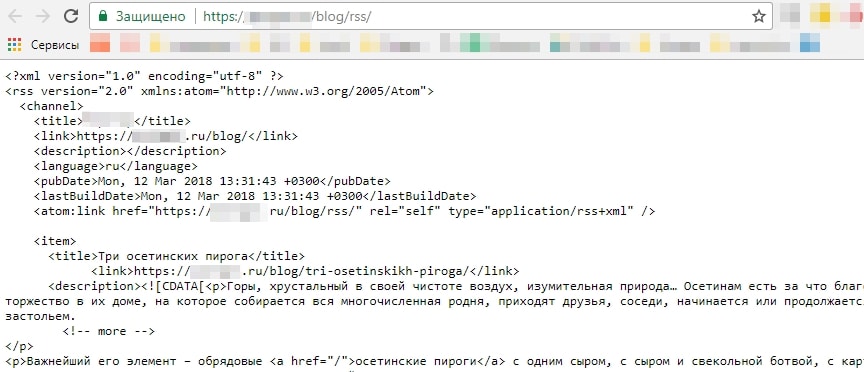

В эту группу относятся страницы robots.txt, Sitemap, RSS-ленты.

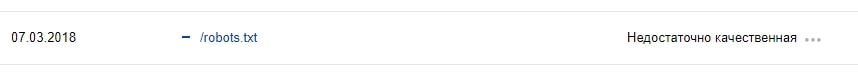

Чуть ли не в каждом проекте можно встретить файл robots.txt, удалённый из поиска как недостаточно качественная страница.

Не стоит паниковать, робот о нём знает и помнит. Страница просто не будет отображаться в поисковой выдаче – ну а зачем она там нужна?

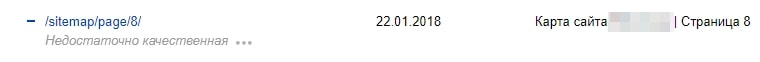

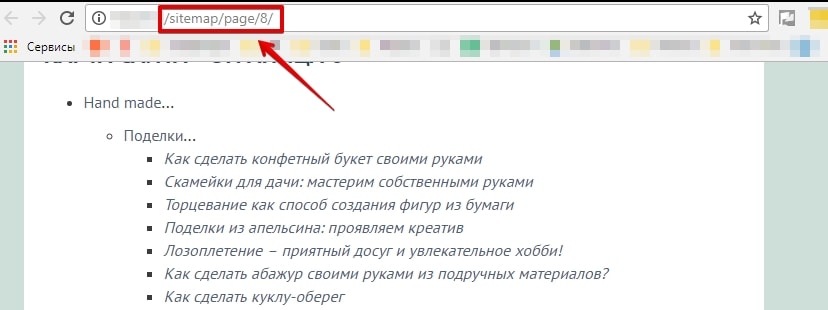

XML- и HTML-карты сайта также исключаются. Особенно если у вас многостраничная карта сайта – какая польза от неё в поиске?

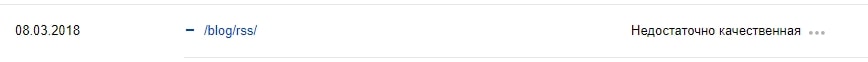

Яндекс считает, что RSS-лентам в поиске тоже нет места.

2.6. Страницы с некорректным ответом сервера

В эту группу мы отнесём страницы, которые должны выдавать 404 ответ сервера, а вместо этого отвечают 200 ОК.

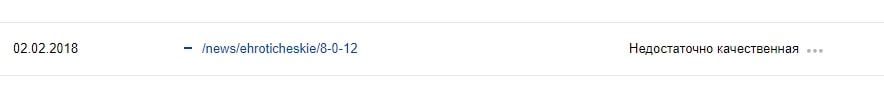

Например, это могут быть несуществующие страницы пагинации. Яндекс исключил восьмую страницу пагинации, при имеющихся семи.

Также это могут быть пустые страницы. В таком случае нужно анализировать и принимать решение: настраивать 404 ответ сервера или 301 редирект.

Google может удалить такие страницы, как SOFT 404, но об этом чуть позже.

2.7. «Нужно больше страниц»

Этим часто грешат агрегаторы и интернет-магазины, считая, что чем больше страниц, тем больше видимость и трафик. Страницы создают, не беря во внимание их качество и надобность.

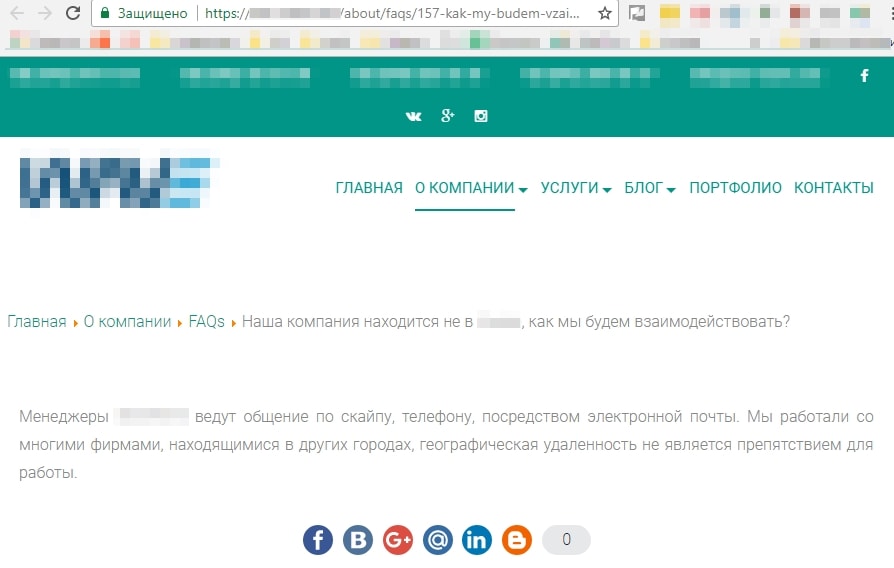

Например, низкокачественными являются страницы, созданные под каждый вопрос из FAQ.

Часто бесполезные страницы создаются с помощью применения всех фильтров. Я соглашусь, что нужно думать о посетителях и удобстве пользования сайтом. Если у интернет-магазина большой ассортимент, то структура сайта должна состоять из множества категорий и подкатегорий, а также иметь различные фильтры. Но, во-первых, нужно ли создавать страницу для «Фарфоровых кукол 20 см с голубыми глазами в розовом платье с корзинкой» и, во-вторых, нужны ли такие страницы в поиске?

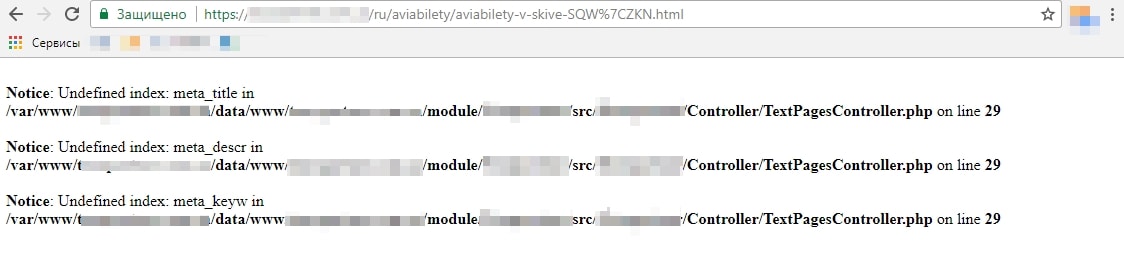

2.8. Технические ошибки

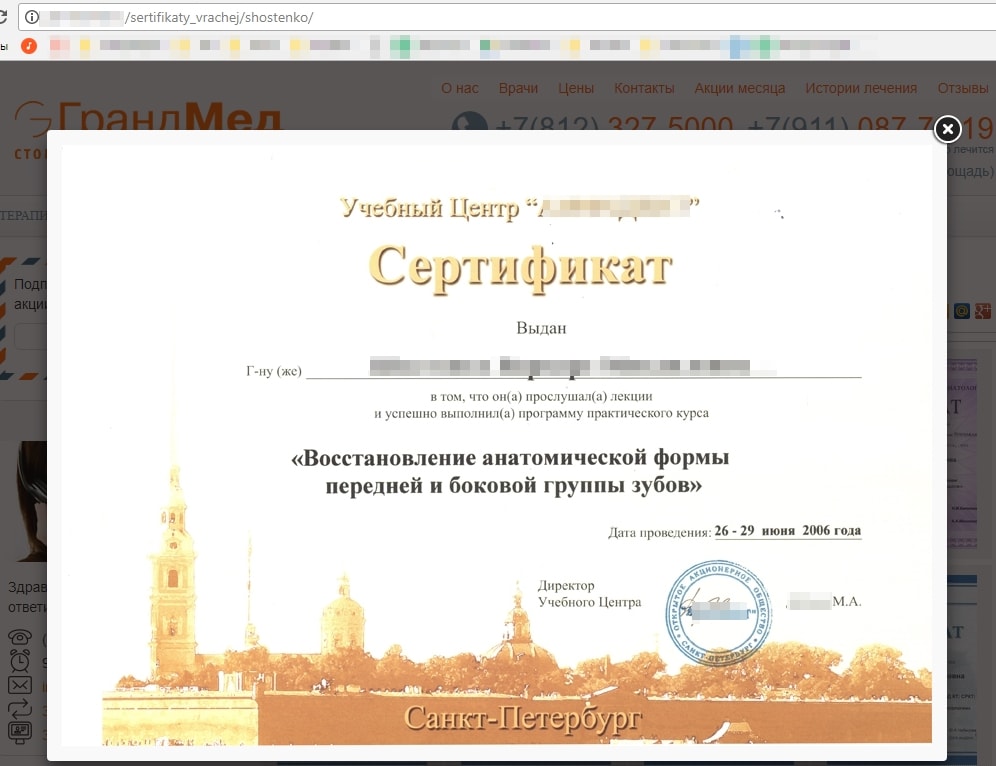

Яндекс не жалует страницы с pop-upом, который перекрывает текст без возможности его закрыть, или случайно созданные страницы под изображения.

Как должно быть и как реализовано на сайте:

Случайно созданная страница:

2.9. SOFT 404

Как мы уже говорили, Google прикрепляет страницам именно такой ярлык. Это могут быть пустые страницы или же страницы с очень малым количеством контента.

Влияние низкокачественных страниц на ранжирование

Сколько бы страниц ни было исключено из поиска по этой причине, на ранжировании остальных страниц сайта это никак не отразится.

Этот алгоритм удаления страниц анализирует каждую страницу отдельно, пытаясь ответить на вопрос: «Если страница будет в поиске, даст ли она релевантный ответ на вопрос пользователя?».

Как говорит Яндекс, страница может быть исключена из поиска даже в том случае, если отсутствуют запросы. Робот может вернуть её, если количество запросов, которым будет релевантна страница, увеличится.

Что же делать со страницами низкого качества

Принимать меры можно только после того, как вы определили причину исключения страницы из поиска. Без выяснения обстоятельств не стоит паниковать, сразу удалять страницы, настраивать 301 редирект.

Алгоритм действий после определения причины удаления страницы:

Дубли страниц: 301 редирект или rel=“canonical”.

Страницы сортировки, пагинации и GET-параметры: настраиваем rel=“canonical”/уникализируем страницы пагинации.

Неглавное зеркало: проверяем 301 редирект, отправляем на переиндексацию.

Страницы, закрытые в файле robots.txt: если страница не нужна в поиске, настраиваем метатег noindex.

Шаблонная генерация страниц: если страница нужна в поиске – уникализируем её, работаем над качеством.

Плохое заполнение карточек товара: добавляем описание товара, изображения и т. д.

Листинг без листинга:

- проверяем, приносили ли такие страницы трафик;

- определяем, нужны ли они пользователям;

- временно ли на них отсутствует товар или его не было и не будет.

Принимаем действия исходя из результата. Например, если страница приносила трафик и на ней временно отсутствует товар, можно вывести ленту с похожими товарами или со смежных категорий.

Страницы с малым количеством контента: определяем необходимость таких страниц в поиске, если они нужны – наполняем качественным контентом; не нужны – настраиваем метатег noindex.

Страницы, не предназначенные для поиска: тут всё просто – ничего не делаем, просто живём с этим.

Страницы с некорректным ответом сервера и SOFT 404: как бы ни логично это прозвучит, настраиваем корректный ответ сервера.

«Нужно больше страниц»: проверяем, приносили ли такие страницы трафик, определяем, нужны ли они пользователям в поиске, частотны ли запросы – принимаем действия исходя из результата.

Страницы с техническими ошибками: исправляем недочёты/если страницы не нужны – закрываем noindex/настраиваем 404 ответ сервера.

ВАЖНО: выше перечислены общие рекомендации, которые чаще всего предпринимаются в той или иной ситуации. Каждый случай нужно рассматривать в индивидуальном порядке, находить оптимальное решение проблемы.

Заключение

К сожалению, выдача поисковых систем переполнена мусором, некачественным контентом и бессмысленными сгенерированными страницами. Яндекс и Google активно борются с такими страницами, исключая их из поиска. Мы за качественный контент. Поэтому, если у вас возникли трудности, вы наблюдаете, как поисковики удаляют страницы, ссылаясь на недостаточное качество, мы можем провести технический аудит вашего сайта и написать инструкции по решению проблемы.

Еще по теме:

- Обзор CMS-систем — какой движок выбрать? Часть 1

- Технический аудит сайта: когда проводить, какие инструменты использовать и что проверять

- 6 плагинов для ускорения сайта на WordPress

Есть вопросы?

Задайте их прямо сейчас, и мы ответим в течение 8 рабочих часов.

-

seoonly.ru

-

Guidetopetersburg.com

-

Али Профи

-

k.peskova

-

-

k.peskova

-

Guidetopetersburg.com

-

-

k.peskova

-

Guidetopetersburg.com

-

k.peskova

-

-

-

Paul A. Wheelwright

-

k.peskova

-

Anna Sebova

-

Paul A. Wheelwright

-

Anna Sebova

-

-

-

-

Елена

-

SiteClinic.Ru

-

-

Ася Некрасова

-

Dmitry Nikitin

-

k.peskova

-

-

Дмитрий Поляков

-

k.peskova

-

-

Саня

-

k.peskova

-

Саня

-

k.peskova

-

-

-

-

Саня

-

SiteClinic.Ru

-

-

SiteClinic.Ru

-

k.peskova

-

Максим

-

SiteClinic.Ru

-

-

Оксана

(22 оценок, среднее: 4,45 из 5)

(22 оценок, среднее: 4,45 из 5)